在人工智能以惊人速度渗透进我们生活每个角落的今天,“AI伦理”早已不是一个陌生的词汇。从科技巨头的原则宣言到各国政府的指导方针,高悬的伦理准则看似为我们构筑了一道安全网。然而,当算法在招聘中无意筛选掉女性简历、当聊天机器人输出带有偏见的言论、当自动驾驶面临不可避免的道德抉择时,一个尖锐的问题浮现出来:那些写在精美报告里的高层原则,如何真正走入代码,成为守护我们日常数字生活的现实力量?

近日,法国国家科学研究中心(CNRS)高级科学家、数字伦理操作委员会主席阿列克谢·克林鲍姆(Alexei Grinbaum)的访谈,为我们剥开了AI伦理从理论到实践的重重迷雾。他的见解揭示,这绝非简单的技术适配,而是一场关乎哲学、技术、法律与社会的深刻变革。

**第一层:原则的“落地之困”——为何伦理条款会失灵?**

当前,全球主要的AI伦理框架普遍围绕透明度、公平、非恶意、责任与隐私等核心原则建立。克林鲍姆指出,首要困境在于“语义鸿沟”。例如,“公平”对哲学家、工程师、律师和用户而言,可能意味着截然不同的东西。是结果的平等?机会的均等?还是程序的公正?缺乏可操作的定义,使得工程师在编写算法时无所适从。

更深层的矛盾在于价值排序。当“隐私保护”(如数据最小化)与“系统性能”(需要更多数据训练)发生冲突时,如何取舍?当“透明度”(要求算法可解释)遭遇“技术复杂性”(如深度学习的黑箱特性)时,又该如何平衡?克林鲍姆强调,伦理原则并非静态的清单,而是一个需要在具体情境中动态权衡的决策框架。许多企业将伦理条款视为一次性的合规检查清单,而非贯穿研发、部署、监控全流程的活态系统,这是其失灵的根源。

**第二层:从“伦理即约束”到“伦理即创新”——工程师需要新工具**

将伦理考量无缝融入开发流程,需要超越道德说教,为工程师提供实实在在的方法论和工具。克林鲍姆所在的团队正致力于此。这包括:

1. **可操作的伦理设计模式**:如同软件设计模式,为常见的伦理困境(如减轻偏见、确保可解释性)提供经过验证的技术方案模板。

2. **影响评估与持续监控**:在系统开发前进行系统的伦理影响评估,并建立上线后的持续审计机制,而不仅仅是最终的产品测试。

3. **跨学科“翻译”团队**:在组织内建立由伦理学家、社会科学家、法律专家和工程师共同组成的小组,专门负责将伦理原则“翻译”成具体的技术要求和产品特性。

克林鲍姆提出一个关键转变:伦理不应被视作创新的绊脚石,而应成为高质量、可持续、可信赖AI的内在创新驱动力。将多元价值观和潜在风险前置思考,往往能催生出更具鲁棒性、更易被社会接纳的技术解决方案。

**第三层:超越技术修复——构建社会技术生态系统**

真正的AI伦理实践,绝不能止步于算法优化。克林鲍姆将视角投向更广阔的社会技术系统。

* **问责制与责任链**:当AI系统造成损害时,责任如何在设计者、开发者、部署者、运营商甚至用户之间清晰划分?这需要法律与技术的协同创新。

* **民主参与与公众理解**:AI系统的规则影响着所有人,其治理不应仅由科技精英决定。如何建立有效的公众咨询、民主审议机制,让受影响社区的声音被听见?

* **文化敏感性与全球对话**:西方主导的伦理原则是否具有普适性?不同文化对自主、尊严、集体利益的权衡存在差异。全球性的AI伦理需要一场真正包容的跨文明对话,而非单一标准的输出。

克林鲍姆以医疗AI为例:一个诊断算法不仅要在技术指标上公平准确,还需考虑它如何改变医患关系、谁对最终诊断负责、如何保障患者的知情同意与数据主权。这已然是一个系统性工程。

**第四层:行动的时刻——每个人都是塑造者**

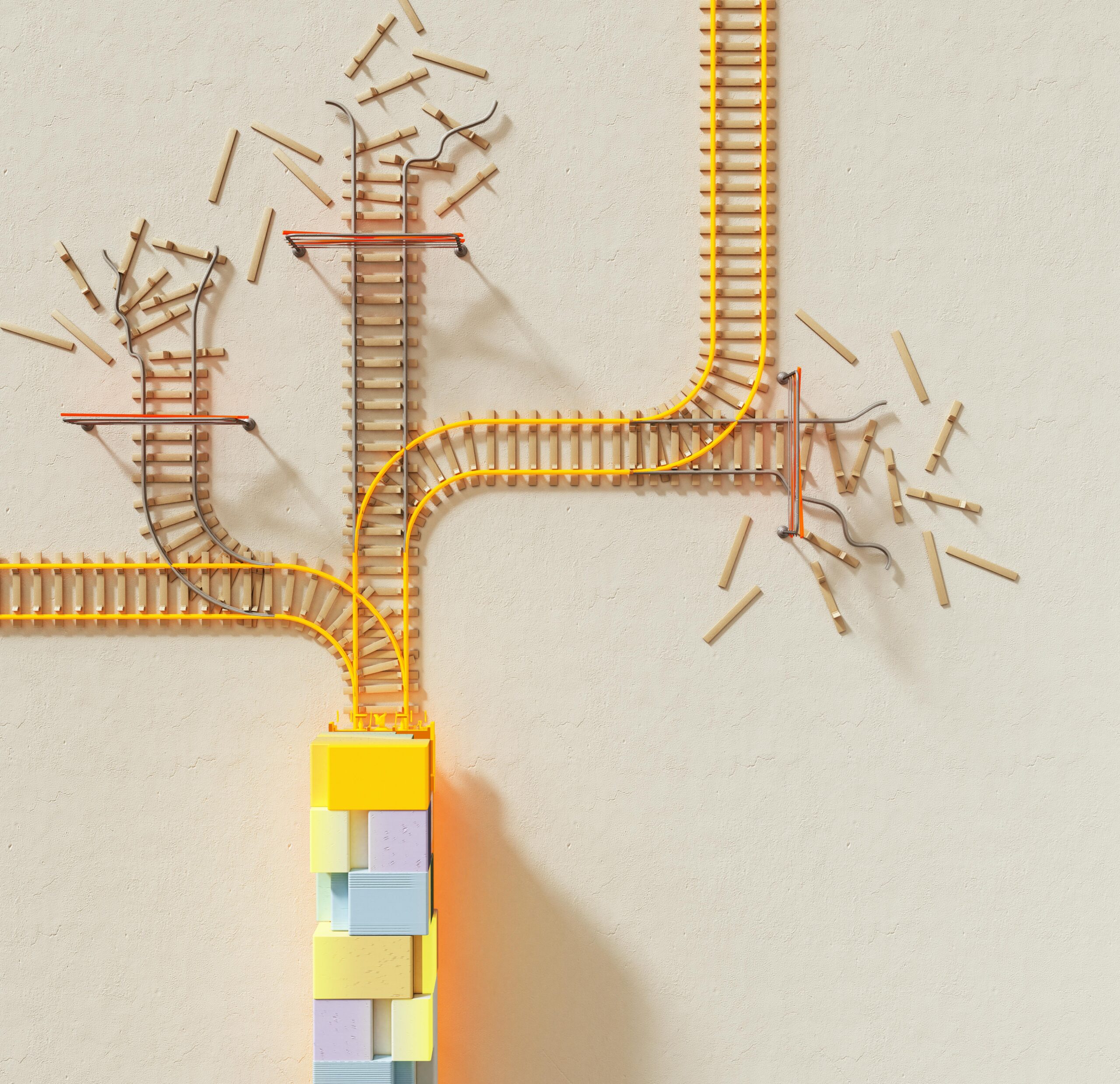

我们正站在AI伦理发展的关键十字路口。克林鲍姆的讨论启示我们,构建负责任的AI未来,需要多方主体的共同行动:

* **政策制定者**:需推动灵活、基于风险的监管框架,鼓励创新同时设定红线,并投资于伦理研究及人才培养。

* **企业与开发者**:必须将伦理深度整合进企业文化和产品生命周期,投资于伦理工具和团队建设,并提高透明度。

* **学术界**:应加强跨学科研究,弥合理论原则与工程实践之间的差距。

* **作为用户的我们**:需要提升数字素养,对AI系统保持审慎的批判意识,积极关注并参与相关公共讨论,用我们的选择向市场传递对负责任技术的需求。

结语:阿列克谢·克林鲍姆的对话清晰地表明,AI伦理从原则到实践的旅程,是一场艰苦但必要的“落地”。它要求我们放弃将伦理视为外挂插件的幻想,转而将其内化为技术发展的基因。这不仅是避免伤害,更是为了引导人工智能朝向增进人类福祉、促进社会公平的星辰大海前行。道路漫长,但每一步扎实的“落地”,都在为我们共同的数字未来奠定更稳固的基石。

**评价引导:**

你认为,在AI伦理实践中,当前最迫切需要突破的瓶颈是技术工具不足、法律问责模糊,还是公众参与缺失?在您的工作或生活中,是否遇到过AI伦理原则与现实冲突的具体情境?欢迎在评论区分享您的见解与案例,让我们共同推动这场关乎未来的重要对话。